Поиск

Показаны результаты для тегов 'звуковых'.

Найдено: 2 результата

-

Интеллектуальные помощники Siri, Alexa и Google Assistant предназначены для того, чтобы человек управлял ими с помощью голоса. Но, как сообщает The New York Times, все три системы восприимчивы к скрытым командам, неуловимым человеческим ухом. Китайские и американские исследователи выяснили, что помощниками можно управлять дозвуковыми командами на радио, в роликах на YouTube или даже белом шуме, что несёт огромную потенциальную угрозу безопасности. Голосового помощника таким образом можно заставить набрать телефонный номер, открыть сайт, совершить платёж или активировать прибор «умного» дома — например, разблокировать дверной замок. Человек в этом время будет слышать что-то другое — начиная от устной речи и заканчивая музыкой. В некоторых случаях ассистенту можно поручить сделать снимок или отправить сообщение. Если в комнате открыто окно, то искусственный интеллект воспримет команду на расстоянии до 7,6 м. Исследователи из Калифорнийского университета в Беркли рассказали, что могут вносить в аудиофайлы небольшие изменения, «убирая звук, который должна была услышать система распознавания речи, и заменяя её звуком, который машинами транскрибируется по-разному, а для человеческого уха практически незаметен». Сотрудники Принстонского и Чжэцзянского университетов усовершенствовали проект, приглушив ИИ-устройство, чтобы его ответы не были слышны пользователю. Новизна проблемы в том, что скрытые команды почти не слышны человеку. Раньше в ТВ-шоу и рекламу открыто помещали фразы, которые активировали определённых интеллектуальных помощников, но скрытые сигналы в звуке — уже эквивалент подсознательной рекламы. Против этого ещё нет никаких законов, поэтому это несёт потенциальную угрозу. Если с проблемой не разобраться, то последствия могут быть катастрофическими. Ожидается, что к 2021 году число телефонов и колонок с голосовыми помощниками превысит число людей на планете. К тому моменту более чем в половине американских домов будет один или несколько «умных» динамиков. Apple, Amazon и Google уже осведомлены о уязвимости, но как именно собираются с ней бороться, неизвестно. Первая говорит, что её устройства имеют определённые ограничения на команды, Amazon — что предприняла меры по обеспечению безопасности колонок Echo, Google — что Assistant оснащён функциями для пресечения скрытых команд.

-

- помощниками

- siri

- (и ещё 9 )

-

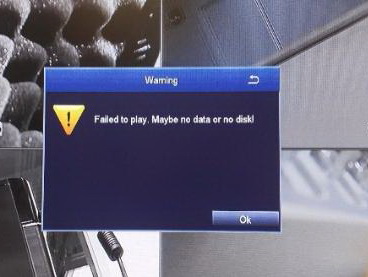

Злоумышленники могут «заморозить» систему видеонаблюдения или вывести из строя компьютеры, выполняющие критические операции, с помощью звуковых волн. Принцип атаки заключается в следующем: звуковые волны провоцируют механические вибрации пластин жестких дисков (HDD), и, если использовать волны на определенной частоте, возникнет усиливающий вибрацию резонанс. Поскольку на жестких дисках большие объемы информации хранятся на небольших участках пластин, они запрограммированы на то, чтобы во избежание царапин и повреждения данных прекращать операции чтения/записи при возникновении вибраций. Сама по себе звуковая атака не является новой. К примеру, в прошлом году сообщалось о прекращении работы европейского дата-центра из-за громкого звука при пожарных учениях. Однако на прошлой неделе ученые Принстонского университета и Университета Пердью опубликовали исследование, расширяющее возможности применения акустической атаки на практике. В ходе исследования ученым удалось осуществить атаки на HDD в цифровых видеорегистраторах, а также в компьютерах под управлением Windows 10, Ubuntu 16 и Fedora 27. Исследователи собрали специальную установку для направления звуковых волн на жесткие диски под разным углом. В ходе исследования они фиксировали частоту волны, продолжительность воздействия, угол и расстояние, при которых HDD переставал работать. Эксперимент прошел без каких-либо трудностей. По словам ученых, у потенциального атакующего также не возникнет никаких проблем при определении условий, необходимых для выведения системы из строя с помощью звуковых волн. Как пояснили исследователи, злоумышленник может генерировать звук с помощью внешнего динамика или использовать динамик, находящийся в непосредственной близости от атакуемой системы. Атакующий может удаленно захватить контроль над ПО (например, мультимедиа-проигрывателем в автомобиле), обманным образом заставить жертву воспроизвести вредоносный аудиофайл (например, прикрепленный к электронному письму) или встроить вредоносный звук в распространенные медиа (например, в телерекламу).