Поиск

Показаны результаты для тегов 'обучаться'.

Найдено: 3 результата

-

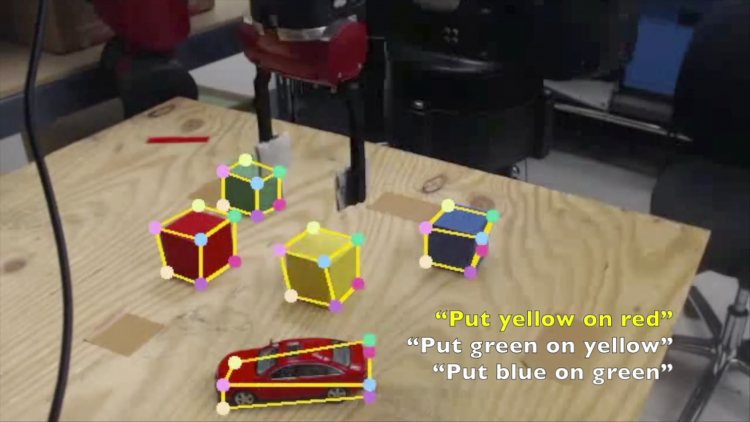

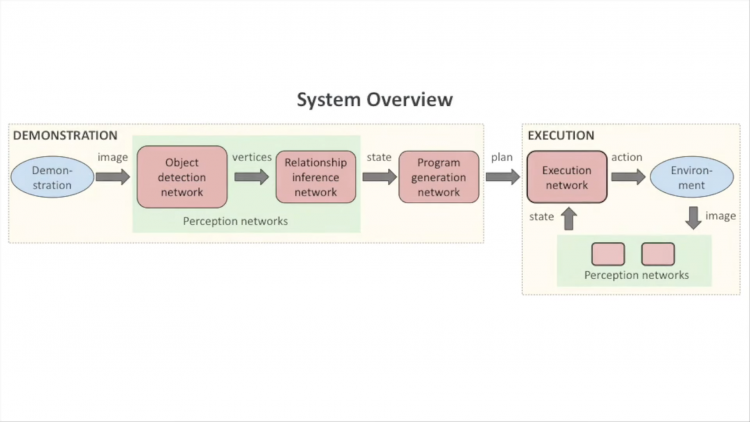

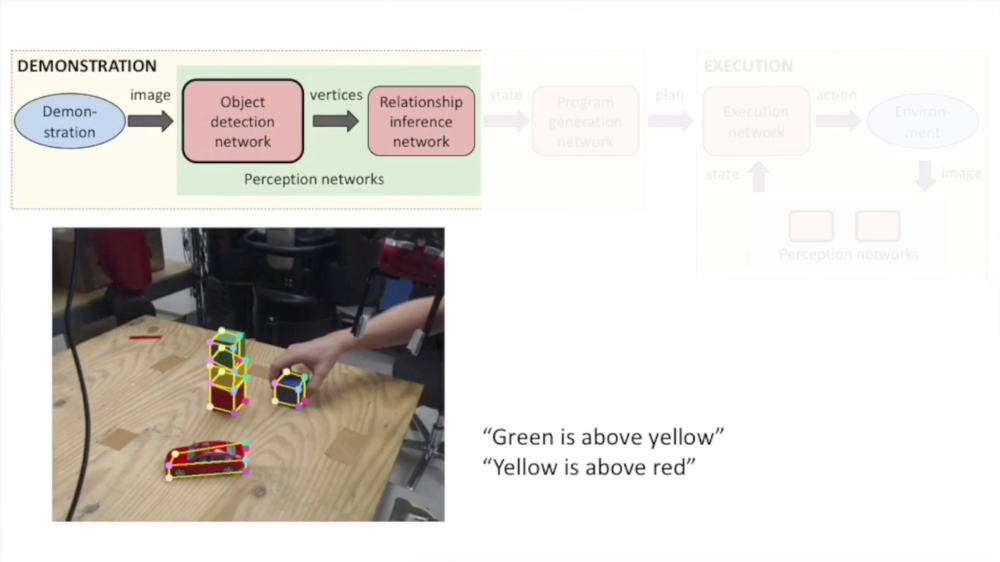

NVIDIA разработала способ обучать роботов выполнять задачи, наблюдая за действиями человека. Компания уже сумела научить робота Baxter поднимать и перемещать разноцветные кубики и игрушечный автомобиль в лабораторных условиях. Предполагается, что благодаря этому машины в конечном счёте смогут спокойно работать бок о бок с людьми. «В производственной среде роботы по-настоящему хорошо повторяют одни и те же действия, но не адаптируются под изменения в окружении и не обучаются задачам, — рассказал главный научный сотрудник NVIDIA Стэн Бёрчфилд (Stan Birchfield). — Поэтому, чтобы научить робота выполнять новую задачу, вы вынуждены пригласить эксперта, который перепрограммирует робота на довольно низком уровне, и это обойдётся вам дорого. Мы заинтересованы в том, чтобы неспециалисты могли обучать роботов новым задачам, просто показывая им что делать». Система работает на базе нескольких нейронных сетей. Они отвечают за восприятие, планирование и управление и обучаются на основе исключительно синтетических данных. «Сейчас в сообществе робототехники наблюдается некоторый сдвиг парадигмы, — продолжил Бёрчфилд. — Мы находимся на том этапе развития, когда с помощью графических процессоров можем бесплатно генерировать, по сути, безграничные объёмы предварительно помеченных данных, а затем разрабатывать и тестировать алгоритмы, и это может позволить нам создавать робототехнические системы, которые будут лучше и безопаснее учиться взаимодействовать с окружающим миром». Система была создана при помощи исследовательской лаборатории робототехники NVIDIA, которую открыли в прошлом году. Сейчас она насчитывает шесть сотрудников, а летом готовится открыть офис, прилегающий к Вашингтонскому университету. «Мы говорим о роботах, которые должны открывать двери и ящики, поднимать и передвигать предметы, даже взаимодействовать с людьми на физическом уровне, помогать им — например, пожилым людям, — добавил руководитель по исследованиям в области робототехники NVIDIA Дитер Фокс (Dieter Fox). — Эти роботы должны уметь узнавать людей, понимать их намерения, учиться у них».

-

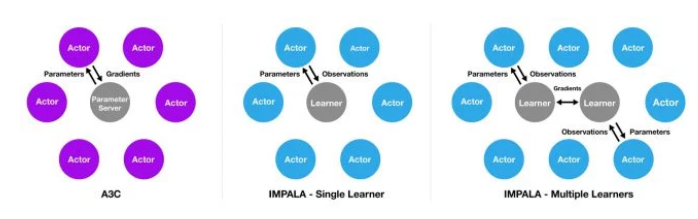

Подразделение компании Google, занимающееся разработками искусственного интеллекта, сообщило о создании нового метода обучения нейронных сетей, сочетающего использование передовых алгоритмов и старых видеоигр. В качестве среды обучения используются старые видеоигры Atari. Разработчики DeepMind (напомним, что эти люди создали нейросеть AlphaGo, неоднократно победившую лучших игроков в логическую игру го) считают, что машины способны обучаться так же, как люди. С помощью тренировочной системы DMLab-30, созданной на базе шутера Quake III и аркадных игр Atari (используются 57 различных игр), инженеры разработали новый алгоритм машинного обучения IMPALA (Importance Weighted Actor-Learner Architectures). Он позволяет отдельным частям обучаться выполнению сразу нескольких задач, а потом обмениваться знаниями между собой. Во многом новая система была основана на более ранней архитектурной системе A3C (Asynchronous Actor-Critic Agents), в которой отдельные агенты исследуют среду, затем процесс приостанавливается, и они обмениваются знаниями с центральным компонентом, «учеником». Что касается IMPALA, то у нее агентов может быть больше, а сам процесс обучения происходит несколько по-другому. В ней агенты посылают информацию сразу двум «ученикам», которые после этого еще и обмениваются данными между собой. Кроме того, если в A3C вычислением градиента функции потерь (другими словами, несоответствия предсказанных и полученных значений параметров) занимаются сами агенты, которые отправляют информацию к центральному ядру, то в системе IMPALA этой задачей занимаются «ученики». Одной из основных проблем при разработке ИИ является время и необходимость в высокой вычислительной мощности. Даже в условиях автономности машинам нужны правила, которым они могли бы следовать в ходе собственных экспериментов и поиска путей решения задач. Так как мы не можем просто построить роботов и выпустить их на волю учиться, разработчики используют симуляции и методы глубокого обучения. Для того чтобы современные нейронные сети могли чему-то научиться, им приходится обрабатывать огромный объем информации, в данном случае — миллиарды кадров. И чем быстрее они это делают, тем меньше времени уходит на обучение. По словам представителей DeepMind, при наличии достаточного числа процессоров IMPALA достигает производительности в 250 000 кадров/с, или 21 миллиард кадров в день. Это абсолютный рекорд для задач такого рода, сообщает портал The Next Web. Сами же разработчики комментируют, что их система ИИ справляется с задачей лучше, чем аналогичные машины и люди. В будущем подобные алгоритмы ИИ можно будет использовать в робототехнике. Благодаря оптимизации систем машинного обучения роботы будут быстрее адаптироваться к окружающей среде и работать эффективнее.

-

Команда исследователей искусственного интеллекта Baidu научила виртуального агента, «живущего» в двухмерном пространстве, использовать для перемещения команды на естественном языке. Агенту задавали различные вопросы, на которые ему приходилось отвечать положительно или отрицательно. По словам учёных, у искусственного интеллекта в результате появились способности к обучению на основе несвязанных данных. Это означает, что агент развил базовое чувство грамматики. Аналогичным образом родители обучают своих детей. Ребёнку показывают картинки, повторяют слова, и по мере того, как положительных ответов становится больше, ребёнок учится ассоциировать слова с изображениями. Прорыв Baidu заключается в том, что её искусственный интеллект может применять изученные команды к новым ситуациям. Обычно компьютер плохо справляется с использованием приобретённых знаний. Ниже представлено официальное описание работы системы. «Люди легко справляются с применением приобретённых знаний к новой задаче, но это по-прежнему вызывает трудности у современных машин сквозного обучения. Машины хоть и могут знать, как выглядит питайя, но они не могут выполнять задачу “порезать питайю ножом”, пока их специально не обучат набору данных, содержащему эту команду. Но наш агент продемонстрировал способность успешно переносить то, что он знал о визуальном облике питайи, на задачу “порезать X ножом”, при этом его не нужно было специально обучать выполнению задачи “нарезать питайю ножом”». Расширение использования навыка, задействованного ранее — немалое достижение для искусственного интеллекта. Это доказывает, что системы могут обучаться и использовать знания так же, как люди, даже если пока это возможно только в рамках простого двухмерного пространства.